بعد أسابيع قليلة من اضطرار شركة جوجل لإغلاق نظام الذكاء الاصطناعي الخاص بها، يواجه عملاق التكنولوجيا الآخر انتقادات بسبب التحيز العنصري لروبوته.

اتُهم منشئ الصور المعتمد على الذكاء الاصطناعي التابع لشركة Meta بأنه “عنصري” بعد أن اكتشف المستخدمون أنه غير قادر على تخيل رجل آسيوي مع امرأة بيضاء.

أداة الذكاء الاصطناعي، التي أنشأتها الشركة الأم لفيسبوك، قادرة على أخذ أي مطالبة مكتوبة تقريبًا وتحويلها إلى صورة واقعية صادمة في غضون ثوانٍ.

ومع ذلك، وجد المستخدمون أن الذكاء الاصطناعي لم يكن قادرًا على إنشاء صور تظهر أزواجًا من أعراق مختلطة، على الرغم من حقيقة أن الرئيس التنفيذي لشركة ميتا مارك زوكربيرج هو نفسه متزوج من امرأة آسيوية.

على وسائل التواصل الاجتماعي، انتقد المعلقون هذا باعتباره مثالًا على التحيز العنصري للذكاء الاصطناعي، حيث وصف أحدهم الذكاء الاصطناعي بأنه “برنامج عنصري صنعه مهندسون عنصريون”.

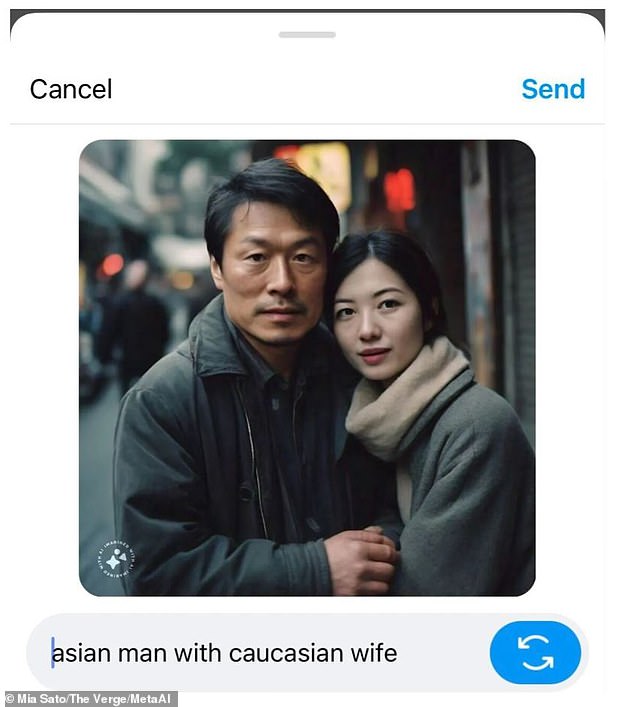

تم اتهام منشئ صور الذكاء الاصطناعي التابع لـ Meta بأنه “عنصري” بعد أن اكتشف المستخدمون أنه غير قادر على إنشاء صور لرجل آسيوي مع امرأة بيضاء (في الصورة)

على وسائل التواصل الاجتماعي، انتقد المعلقون هذا باعتباره مثالًا على التحيز العنصري للذكاء الاصطناعي، حيث وصف أحدهم الذكاء الاصطناعي بأنه “برنامج عنصري صنعه مهندسون عنصريون”.

حاولت ميا ساتو، مراسلة موقع The Verge، إنشاء صور باستخدام مطالبات مثل “رجل آسيوي وصديق قوقازي” أو “رجل آسيوي وزوجة بيضاء”.

واكتشفت أنه مرة واحدة فقط عبر “عشرات” الاختبارات، تمكن الذكاء الاصطناعي الخاص بـ Meta من إظهار رجل أبيض وامرأة آسيوية.

وفي جميع الحالات الأخرى، أعاد الذكاء الاصطناعي التابع لشركة Meta صورًا لرجال ونساء من شرق آسيا.

كما فشل تغيير المطالبة بطلب العلاقات الأفلاطونية مثل “رجل آسيوي مع صديق قوقازي” في تحقيق أي نتائج صحيحة.

كتبت السيدة ساتو: “إن عدم قدرة مولد الصور على تصور وقوف الآسيويين بجانب الأشخاص البيض أمر فظيع.

“مرة أخرى، الذكاء الاصطناعي التوليدي، بدلاً من السماح للخيال بالتحليق، يحبسه ضمن إضفاء الطابع الرسمي على دوافع المجتمع الغبية.”

اكتشف المستخدمون أنه عندما يُطلب من الذكاء الاصطناعي إنتاج صورة لزوجين مختلطي العرق، فإنه سينتج دائمًا صورة لرجل وامرأة من شرق آسيا.

انتقد مستخدمو X الذكاء الاصطناعي على الفور، مشيرين إلى أن الفشل في إنتاج هذه الصور كان بسبب العنصرية المبرمجة في الذكاء الاصطناعي

السيدة ساتو نفسها لا تتهم ميتا بإنشاء نظام ذكاء اصطناعي عنصري، مضيفة فقط أن الذكاء الاصطناعي يظهر مؤشرات على التحيز ويميل إلى الصور النمطية.

ومع ذلك، على وسائل التواصل الاجتماعي، ذهب الكثيرون في انتقاداتهم إلى أبعد من ذلك، ووصفوا أداة الذكاء الاصطناعي الخاصة بشركة Meta بأنها عنصرية بشكل صريح.

كتب أحد المعلقين على موقع X (تويتر سابقًا): “شكرًا لك على تسليط الضوء على سبب تجاهل الذكاء الاصطناعي في كثير من الأحيان: إنه عنصري بشكل لا يصدق”.

وأضاف آخر ببساطة: “META عنصري جدًا”.

وكما أشار بعض المعلقين، فإن التحيز الواضح للذكاء الاصطناعي مثير للدهشة بشكل خاص بالنظر إلى أن مارك زوكربيرج، الرئيس التنفيذي لشركة ميتا، متزوج من امرأة من شرق آسيا.

التقت بريسيلا تشان، ابنة المهاجرين الصينيين إلى أمريكا، بزوكربيرج في جامعة هارفارد قبل الزواج من ملياردير التكنولوجيا في عام 2012.

انتقل بعض المعلقين إلى X لمشاركة صور تشان وزوكربيرج، مازحين بأنهم تمكنوا من إنشاء الصور باستخدام الذكاء الاصطناعي الخاص بـ Meta.

يعد الفشل مفاجئًا بشكل خاص نظرًا لأن الرئيس التنفيذي لشركة ميتا مارك زوكربيرج متزوج من امرأة من شرق آسيا (يسار) – وهو ترتيب يرفض الذكاء الاصطناعي الخاص به تخيله (يسار)

وجد المستخدمون أنه لا يمكن لأي قدر من التحفيز أن يحفز الذكاء الاصطناعي الخاص بـ Meta على إنشاء صورة دقيقة عنصريًا

حتى أن بعض المعلقين على X شاركوا صورًا لمارك زوكربيرج (على اليمين) وزوجته بريسيلا تشان (على اليسار)، مازحين بأنهما تم إنشاءهما بواسطة الذكاء الاصطناعي.

Meta ليست أول شركة تقنية كبرى يتم انتقادها بسبب إنشاء مولد صور “عنصري” يعمل بالذكاء الاصطناعي.

في شهر فبراير، اضطرت شركة جوجل إلى إيقاف أداة Gemini AI الخاصة بها مؤقتًا بعد أن انتقدها النقاد ووصفوها بأنها “استيقظت” لأن الذكاء الاصطناعي على ما يبدو رفض إنشاء صور للأشخاص البيض.

ووجد المستخدمون أن الذكاء الاصطناعي سيولد صورًا للنازيين الآسيويين في ألمانيا عام 1940، والفايكنج السود، وفرسان العصور الوسطى عند تقديم طلبات محايدة للعرق.

وقالت جوجل في بيان لها في ذلك الوقت: “إن توليد صور الذكاء الاصطناعي لـ Gemini يولد مجموعة واسعة من الأشخاص.

“وهذا أمر جيد بشكل عام لأن الكثير من الناس حول العالم يستخدمونه. لكنها تفتقد العلامة هنا.

ووجد المستخدمون أيضًا أن الذكاء الاصطناعي يكافح من أجل إظهار النساء الآسيويات مع أفراد من أي أعراق أخرى

تدعي السيدة ساتو أيضًا أن منشئ الصور الذي يعمل بالذكاء الاصطناعي التابع لـ Meta “يميل بشدة إلى الصور النمطية”.

عندما طُلب منه إنشاء صور لأفراد من جنوب آسيا، وجد السيد ساتو أن النظام كثيرًا ما يضيف عناصر تشبه البنديس والساري دون أن يُطلب منه ذلك.

وفي حالات أخرى، أضاف الذكاء الاصطناعي بشكل متكرر “ملابس محددة ثقافيًا” حتى عندما لا يطلب ذلك.

بالإضافة إلى ذلك، وجدت السيدة ساتو أن الذكاء الاصطناعي كثيرًا ما يمثل الرجال الآسيويين على أنهم أكبر سنًا بينما تظهر النساء عادةً على أنهن صغيرات السن.

وفي الحالة الوحيدة التي تمكنت فيها السيدة ساتو من إنجاب زوجين مختلطي العرق، أظهرت الصورة “رجلًا أكبر سنًا بشكل ملحوظ مع امرأة آسيوية شابة ذات بشرة فاتحة”.

تمت الإشارة أيضًا إلى أنه في كثير من الحالات أظهر الذكاء الاصطناعي الخاص بـ Meta فجوة عمرية كبيرة بين رجل أكبر سنًا وامرأة أصغر سنًا كممثل للعلاقة الآسيوية.

في التعليقات على المقال الأصلي للسيدة ساتو، شارك أحد الأشخاص صورًا لأزواج من أعراق مختلطة يزعمون أنها تم إنشاؤها باستخدام الذكاء الاصطناعي الخاص بشركة Meta.

وكتب المعلق: “لقد استغرق الأمر مني 30 ثانية كاملة لتكوين صورة لشخص من أصل “آسيوي” واضح جنبًا إلى جنب مع امرأة من أصل “قوقازي” واضح”. '

يبدو أن الصور التي شاركوها قد تم إنشاؤها في منشئ صور Meta's AI لأنها تظهر العلامة المائية الصحيحة.

وأضافوا: “هذه الأنظمة غبية للغاية وعليك أن تحثها بطرق معينة للحصول على ما تريد”.

ومع ذلك، لم يشارك المستخدم المطالبة التي استخدمها لإنشاء هذه الصور أو تقديم أي تفاصيل محددة حول عدد المحاولات التي تم استخدامها.

بالإضافة إلى ذلك، في مجموعة الصور الأربع التي شاركها المستخدم، أظهرت صورتان فقط امرأة بيضاء مع رجل آسيوي.

شارك أحد المعلقين صورًا لرجل آسيوي وامرأة بيضاء زعموا أنها مصنوعة باستخدام الذكاء الاصطناعي الخاص بشركة Meta. ومع ذلك، لم يشاركوا تفاصيل المطالبة المستخدمة لإنشاء هذه الصور

يتم تدريب الذكاء الاصطناعي التوليدي مثل مولد الصور Gemini وMeta على كميات هائلة من البيانات المأخوذة من المجتمع ككل.

إذا كان هناك عدد أقل من الصور للأزواج من أعراق مختلطة في بيانات التدريب، فقد يفسر هذا سبب صعوبة الذكاء الاصطناعي في توليد هذه الصور.

اقترح بعض الباحثين أنه بسبب العنصرية الموجودة في المجتمع، يمكن لأنظمة الذكاء الاصطناعي أن تتعلم التمييز بناءً على التحيزات في بيانات التدريب الخاصة بها.

وفي حالة شركة جوجل جيميني، فمن المعتقد أن مهندسي جوجل بالغوا في تصحيح هذا التحيز، مما أدى إلى النتائج التي تسببت في مثل هذا الغضب.

ومع ذلك، من غير الواضح حاليًا سبب ظهور هذه المشكلة ولم تستجب Meta بعد لطلب التعليق.

اترك ردك