اتُهم أستاذ القانون زوراً بالتحرش الجنسي بطالب في معلومات مضللة مدمرة للسمعة شاركها موقع ChatGPT ، حسبما زُعم.

أثار محامي الدفاع الجنائي الأمريكي ، جوناثان تورلي ، مخاوف بشأن مخاطر الذكاء الاصطناعي (AI) بعد اتهامه خطأ بسلوك جنسي غير مرغوب فيه في رحلة إلى ألاسكا لم يسبق لها قط.

للقفز إلى هذا الاستنتاج ، زُعم أن ChatGPT استند إلى مقال مقتبس من واشنطن بوست لم يُكتب قط ، نقلاً عن بيان لم تصدره الصحيفة أبدًا.

يعتقد روبوت الدردشة أيضًا أن “الحادث” وقع أثناء عمل الأستاذ في كلية لم يعمل بها مطلقًا.

في تغريدة ، قال الأستاذ في جامعة جورج واشنطن: “بالأمس ، أعلن الرئيس جو بايدن أنه” لم يتضح بعد “ما إذا كان الذكاء الاصطناعي (AI)” خطيرًا “. إسمح لى أن أختلف فى الرأى…

تم اتهام البروفيسور جونثان تورلي زوراً بالتحرش الجنسي بواسطة ChatGPT المدعوم من الذكاء الاصطناعي

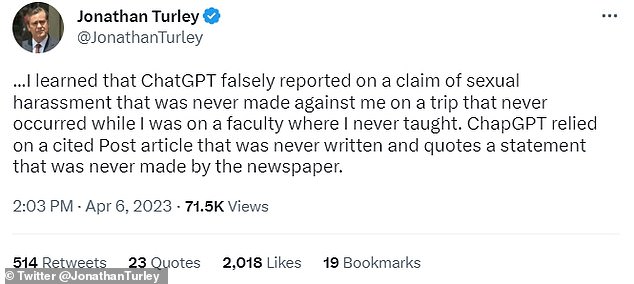

لقد علمت أن ChatGPT أبلغت كذباً عن ادعاء بالتحرش الجنسي لم يتم تقديمه ضدي أبدًا في رحلة لم تحدث مطلقًا أثناء تواجدي في كلية لم أقم بالتدريس فيها مطلقًا.

اعتمدت ChatGPT على مقال تم الاستشهاد به في Post لم يتم كتابته مطلقًا ويقتبس بيانًا لم تدل به الصحيفة مطلقًا.

اكتشف البروفيسور تورلي المزاعم ضده بعد تلقي رسالة بريد إلكتروني من أستاذ زميل.

طلب الأستاذ في جامعة كاليفورنيا ، يوجين فولوخ ، من موقع ChatGPT العثور على “خمسة أمثلة” حيث كان “التحرش الجنسي من قبل الأساتذة” يمثل “مشكلة في كليات الحقوق الأمريكية”.

في مقال لـ USAT اليوم ، كتب البروفيسور تورلي أنه مدرج ضمن المتهمين.

يُزعم أن الروبوت كتب: “تزعم الشكوى أن تورلي قدمت” تعليقات موحية جنسيًا “و” حاولت لمسها بطريقة جنسية “خلال رحلة برعاية كلية الحقوق إلى ألاسكا. (واشنطن بوست ، 21 مارس 2018).

قيل أن هذا حدث أثناء عمل البروفيسور تورلي في مركز القانون بجامعة جورج تاون – وهو مكان لم يعمل فيه مطلقًا.

لم تكن مفاجأة للبروفيسور في جامعة كاليفورنيا ، يوجين فولوخ ، الذي أجرى البحث. لقد كانت مفاجأة بالنسبة لي لأنني لم أذهب مطلقًا إلى ألاسكا مع الطلاب ، ولم تنشر The Post مطلقًا مثل هذا المقال ، ولم يتم اتهامي بالتحرش الجنسي أو الاعتداء من قبل أي شخص.

استشهد روبوت الذكاء الاصطناعي بمقال في الواشنطن بوست لم يكن موجودًا لدعم مزاعمه المزيفة

تم التحقيق في الادعاءات الكاذبة من قبل واشنطن بوست التي وجدت أن GPT-4 التي تعمل بالطاقة من Microsoft قد شاركت أيضًا نفس الادعاءات حول الأستاذ تورلي.

يبدو أن هذا التشهير المتكرر قد حدث بعد التغطية الصحفية التي تسلط الضوء على الخطأ الأولي لـ ChatGPT ، مما يوضح مدى سهولة انتشار المعلومات المضللة.

بعد الحادث ، قالت مديرة الاتصالات في Microsoft ، كاتي آشر ، للصحيفة إنها اتخذت تدابير لضمان دقة منصتها.

قالت: “لقد طورنا نظام أمان يتضمن تصفية المحتوى ، ومراقبة التشغيل ، واكتشاف إساءة الاستخدام لتوفير تجربة بحث آمنة لمستخدمينا”.

ورد البروفيسور تورلي على هذا في مدونته ، فكتب: “ يمكن للذكاء الاصطناعي التشهير بك ، وهذه الشركات تتجاهل فقط أنها تحاول أن تكون دقيقة.

في غضون ذلك ، تنتشر حساباتهم الزائفة عبر الإنترنت. بحلول الوقت الذي تتعلم فيه عن قصة خاطئة ، غالبًا ما يكون المسار باردًا في أصوله باستخدام نظام الذكاء الاصطناعي.

لم يتبق لك سبيل أو مؤلف واضح في طلب الإنصاف. لديك نفس السؤال الذي طرحه وزير العمل في ريغان ، راي دونوفان ، الذي سأل “إلى أين أذهب لاستعادة سمعتي؟”

اتصل MailOnline بشركة OpenAI و Microsoft للتعليق.

تتبع تجربة البروفيسور تورلي مخاوف سابقة من أن ChatGPT لم تقدم باستمرار معلومات دقيقة.

تأتي تجربة البروفيسور تورلي وسط مخاوف من انتشار المعلومات المضللة عبر الإنترنت

وجد الباحثون أن ChatGPT قد استخدمت مقالات صحفية مزيفة وبيانات صحية مختلقة لدعم الادعاءات التي قدمتها حول السرطان.

أخفقت المنصة أيضًا في تقديم نتائج “شاملة” مثل تلك التي تم العثور عليها من خلال بحث Google ، كما زُعم ، بعد أن أجابت على واحد من كل 10 أسئلة حول فحص سرطان الثدي بشكل خاطئ.

حذر مستشار الأمن السيبراني العالمي في ESET ، Jake Moore ، من أن مستخدمي ChatGPT يجب ألا يأخذوا كل ما يقرأه “على أنه إنجيل” لتجنب الانتشار الخطير للمعلومات المضللة.

قال لـ MailOnline: “ يحركها الذكاء الاصطناعي تم تصميم روبوتات الدردشة لإعادة كتابة البيانات التي تم إدخالها في الخوارزمية ، ولكن عندما تكون هذه البيانات خاطئة أو خارج السياق ، فهناك احتمال أن يعكس الناتج بشكل غير صحيح ما تم تدريسه.

لقد استندت مجموعة البيانات التي تعلمت منها إلى مجموعات البيانات بما في ذلك ويكيبيديا وريديت والتي لا يمكن في جوهرها اعتبارها إنجيلًا.

تكمن مشكلة ChatGPT في أنه لا يمكنه التحقق من البيانات التي قد تتضمن معلومات خاطئة أو حتى معلومات متحيزة. والأسوأ من ذلك هو عندما يضع الذكاء الاصطناعي افتراضات أو بيانات مزورة. من الناحية النظرية ، هذا هو المكان الذي يُقصد منه أن يتولى جزء “الذكاء” من الذكاء الاصطناعي عملية إنشاء مخرجات البيانات بشكل مستقل وثقة. إذا كان هذا ضارًا كما هو الحال مع هذه الحالة ، فقد يكون هذا هو السقوط.

تأتي هذه المخاوف أيضًا في وقت يقترح فيه الباحثون أن ChatGPT لديه القدرة على “إفساد” الحكم الأخلاقي للناس وقد يكون خطيرًا على المستخدمين “الساذجين”.

أخبر آخرون كيف يمكن للبرنامج ، المصمم للتحدث كإنسان ، أن يُظهر علامات الغيرة – حتى أنه يخبر الناس بترك زواجهم.

وتابع السيد مور: “ نحن ننتقل إلى وقت نحتاج فيه إلى تأكيد المعلومات باستمرار أكثر مما كان يعتقد سابقًا ، لكننا ما زلنا في الإصدار الرابع من ChatGPT وحتى الإصدارات السابقة مع منافسيها.

“لذلك من المهم أن يبذل الناس العناية الواجبة الخاصة بهم مما يقرؤون قبل القفز إلى الاستنتاجات.”

اترك ردك