كان هناك وقت عندما شاهدت صورة أو مقطع فيديو بعيونك ، يمكن الوثوق به.

في حين كان على الأشخاص في السابق أن يكونوا حذرين من المكالمات الهاتفية التي تنتحل شخصية عن خداعهم أو عمليات احتيال عتبة الباب ، إلا أنهم كانوا على الأقل يعرفون مقاطع الفيديو الخاصة بالشخصيات العامة التي رأوها على شاشة التلفزيون أو على هواتفهم المحمولة حقيقية.

لكن التكنولوجيا الجديدة تعني أن أي شخص تقريبًا يمكنه إنشاء مقاطع فيديو تُعرف باسم DeepFakes والتي تم تصميمها لتجميل أموالك.

يستخدم المحتالون الآن منظمة العفو الدولية لخلق أوجه شبهة مقنعة للأشخاص المشهورين – وأصبح من الصعب على نحو متزايد تحديد موقعه.

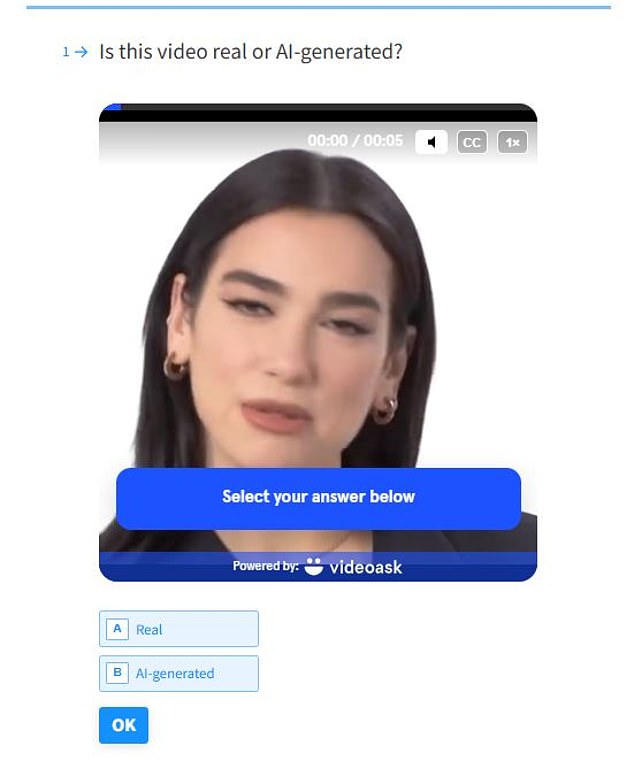

أظهر مكتشف موقع مقارنة الأموال أن 2000 شخص ثم ثمانية مقاطع من خمس ثوان-بعضها حقيقي ، وبعضهم مزيف-من المشاهير المؤثرة والشخصيات العامة بما في ذلك دوا ليبا ، وكيم كارداشيان ، وإيلون موسك ، وجيف بيزوس.

طلبوا منهم تحديد أي منها كانت حقيقية ، والتي كانت مزيفة من الذكاء الاصطناعي.

كانت المقاطع المزيفة مقنعة لدرجة أن أكثر من 96 في المائة من الناس قد تعرضوا لخطأ واحد على الأقل.

يمكنك إجراء الاختبار أدناه لترى عدد ما ستحصل عليه بشكل صحيح – ثم قراءة نصائحنا حول كيفية تحديد فيديو عملية احتيال مزيفة.

هل يمكنك اكتشاف DeepFake؟ طلب الباحث من 2000 شخص فرز عمليات الاحتيال من مقاطع فيديو حقيقية للمشاهير – ولم يثبت ذلك سهلاً

ما هو deepfake؟

Deepfakes هي مقاطع فيديو أو صور فوتوغرافية أو مقاطع صوتية يتم تغييرها أو إنشاءها باستخدام الذكاء الاصطناعي.

تستخدم تقنية DeepFake مقاطع صوتية ومقاطع فيديو وصور لشخص ما لإنشاء مقاطع فيديو وصور تعرض لهم يفعلون أو يقولون أشياء لم يفعلوها أبدًا.

يتم إعادة تشبيه الشخص بشكل مقنع في DeepFake باستخدام التعلم الآلي. هذا هو المكان الذي سيتم فيه تدريب الكمبيوتر مع ساعات من لقطات موجودة من هذا الشخص ، كما يقول Finder.

يمكن للتكنولوجيا معالجة مقطع فيديو موجود أو إنشاء مقطع فيديو جديد تمامًا. ولا يقتصر الأمر على أولئك الذين لديهم مهارات التكنولوجيا الخبراء ، حيث يمكن إنشاؤها باستخدام برامج مجانية متوفرة عبر الإنترنت.

على الرغم من أن هذه التكنولوجيا لها استخدامات حميدة ، مثل العمل الإبداعي أو صنع مقاطع فيديو مضحكة لوسائل التواصل الاجتماعي ، فإن المحتالين قد استولى على التكنولوجيا ويستخدمونها لسرقة الأموال من الضحايا في عمليات احتيال جديدة.

حقيقي أم مزيف؟ خذ اختبار الباحث بنفسك أدناه لترى مدى جودة محاكاة محاكاة ساخرة لمنظمة العفو الدولية

كيف تعمل عمليات احتيال Deepfake؟

يقول Finder ، إن أحدهم من كل خمسة أشخاص واجهوا عملية احتيال ديبفيك أو ذكاء الذكاء الاصطناعى ، وسقط واحد من كل ثلاثة من هؤلاء الأشخاص في الحيلة.

وهذا يعني أن ما يصل إلى 3.4 مليون شخص في جميع أنحاء البلاد ربما يكون قد تم إغرائهم من خلال مقاطع الفيديو والصور الفوتوغرافية التي تم تغييرها.

غالبًا ما تبدأ عمليات الاحتيال على وسائل التواصل الاجتماعي ، حيث قد يظهر مقطع فيديو مشاهير أو نجم تلفزيوني أثناء النهار أو أي شخص آخر يعاني من استثمار جديد “قد يجعلك الكثير من المال”.

لكن الاستثمار ليس حقيقيًا – ولم يعيده المشاهير.

بدلاً من ذلك ، إنه مقطع فيديو مزيف تم تعويضه بواسطة مخادع. إنهم يسحبون الأوتار ويجبرون المشاهدين على “استثمار” أموالهم في مخطط مزيف.

بمجرد الرد على الإعلان ، سيتم إغراءك لاستثمار بعض أموالك. غالبًا ما يظهرون لك لقطات شاشة مزيفة وتفاصيل الحساب مع عوائدك المرتفعة.

لكنها ببساطة خدعة مصممة لتحصل على المزيد من أموالك التي تم الحصول عليها بشق الأنفس.

يمكن أيضًا استخدام مقاطع فيديو DeepFake في عمليات الاحتيال الرومانسية ، لإقناع الضحية بالضحية التي يعتقدون أنها تعتقد أنها ترس على الإنترنت هي حقيقية والقضاء على أي شكوك.

لا تقتصر هذه عمليات الاحتيال على نجوم البوب وأسماء العروض الواقعية.

أهم أرقام مالية بما في ذلك المؤسس المشارك لـ Hargreaves Lansdown Peter Hargreaves ومدير صندوق Fidelity Star السابق ، أنتوني بولتون ، على حد سواء تشبههم مؤخرًا من قبل المحتالين الذين يرغبون في خداع المشاهدين في الفراق بأموالهم.

على سبيل المثال ، دعا مقطع الفيديو المولد من الذكاء الاصطناعي مقطع فيديو بدا وكأنه بولتون ، على سبيل المثال ، للمستثمرين للانضمام إلى مجموعة WhatsApp لتصرف الأسهم.

على الرغم من أن الفيديو لم يكن من بولتون ، إلا أن المستثمرين تم إغراءهم بمثل الفيديو.

اكتشف هذا التحقيق الأموال أن هذا الفيديو المزيف كان وراء عملية احتيال للمضخة والتفريغ حيث استخدم المحتالون مجموعة WhatsApp لمشاركة نصيحة “الخبراء” التي يجب شراؤها من أجل تضخيم سعرها.

بعد ذلك ، بمجرد أن ترتفع قيمتها بعد مساحات سكان من الضحايا الذين يستثمرون أموالهم ، انخفض. فقد المساهمون في جميع أنحاء العالم المال في غمضة عين.

لكن في الوقت نفسه ، أصبحت مجموعة من المحتالين المجهولين – أعضاء محتملين من العصابات الإجرامية المنظمة – غنية للغاية.

ليس فقط الشخصيات المعروفة التي يمكن نسخها في مقاطع فيديو DeepFake هذه.

يمكن لمحتال الاحتيال أن ينتحل الشخصية لفتح حساب مصرفي جديد باسمك ، أو يمكن أن يقلد أحد أفراد أسرته في حاجة مالية أو طبية لجعلك تنفصل عن أموالك ،

هل ستقع ضحية؟

من المحتمل جدًا أن تكون قد شاهدت في مرحلة ما مقطع فيديو تم تغييره أو إنشاؤه باستخدام تقنية DeepFake واعتقد أنه حقيقي.

قدم Finder ثمانية مقاطع فيديو لآلاف البالغين لمعرفة ما إذا كان بإمكانهم تخمين مقاطع فيديو المشاهير بشكل صحيح والتي كانت حقيقية والتي كانت DeepFakes.

النتائج مروعة. فقط 3.7 في المائة من الأشخاص الذين شاهدوا مقاطع الفيديو هذه ، خمنوا بشكل صحيح أن مقاطع الفيديو كانت حقيقية والتي كانت مزيفة.

تمكن 57 في المائة فقط من الأشخاص من تحديد أكثر من نصف مقاطع الفيديو بشكل صحيح ، بينما سجل 18 في المائة فقط أكثر من ستة من أصل ثمانية.

كان متوسط النتيجة 4.8 من أصل ثمانية مقاطع فيديو خمنت بشكل صحيح.

دعنا نعرف لك تسجيل في قسم التعليق.

قالت لويز باستوك ، خبيرة المالية الشخصية في Finder: 'Deepfake و AI الاحتيال هنا للبقاء. حوالي 6.4 في المائة من السكان الذين سقطوا فريسة لها هو بالفعل كمية كبيرة ، وسيستمر فقط في النمو.

كان الجمهور قادرًا عمومًا على تخمين بعض مقاطع الفيديو بشكل صحيح في اختبارنا ، لكن لا أحد يصححها تقريبًا ، وهذا هو الخطر.

“يجب عليك فقط أن يتم القبض عليها مرة واحدة ويمكن أن يكون لها عواقب مدمرة.”

سجل المشاهدون في الجيل Z – الذين عادة ما يتعرضون لمقاطع فيديو DeepFake على وسائل التواصل الاجتماعي – بشكل كبير حيث حصلوا على 5.7 مقاطع فيديو في المتوسط في حين أن 74 في المائة قد خمنوا أكثر من نصف مقاطع الفيديو بشكل صحيح.

سجل جيل الألفية أيضًا بقوة حيث خمنوا بشكل صحيح حوالي 4.9 مقاطع فيديو من الثمانية. لكن الذين تزيد أعمارهم عن 61 عامًا فعلوا بشكل سيء حيث سجلوا 4.2 فقط.

اترك ردك