تقدم Meta أداة لتحديد الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي والتي يتم مشاركتها على منصاتها وسط ارتفاع عالمي في المحتوى الاصطناعي الذي ينشر معلومات مضللة.

نظرًا لوجود العديد من الأنظمة على الويب، تهدف الشركة المملوكة لمارك زوكربيرج إلى توسيع التصنيفات لتشمل شركات أخرى مثل Google وOpenAI وMicrosoft وAdobe.

وقالت Meta إنها ستطرح ميزة التصنيف بالكامل في الأشهر المقبلة وتخطط لإضافة ميزة تتيح للمستخدمين الإبلاغ عن المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي.

ومع ذلك، فإن السباق الرئاسي الأمريكي على قدم وساق، مما يترك البعض يتساءل عما إذا كانت العلامات سيتم نشرها في الوقت المناسب لمنع انتشار المحتوى المزيف.

وتأتي هذه الخطوة بعد أن حث مجلس الرقابة التابع لشركة Meta الشركة على اتخاذ خطوات لتصنيف الصوت والفيديو الذي تم التلاعب به والذي قد يضلل المستخدمين.

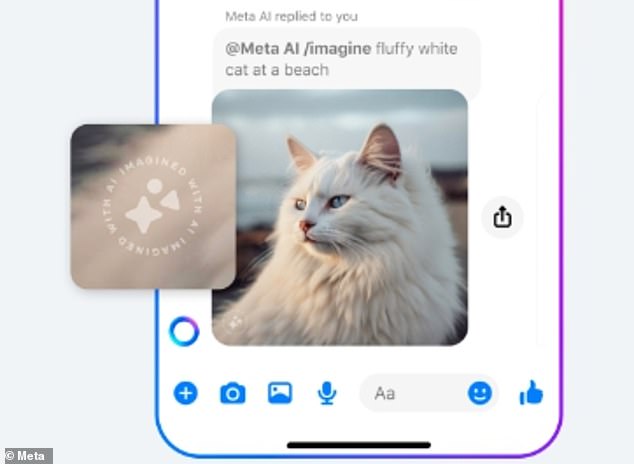

تقوم Meta بطرح أداة لتحديد المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي والذي تم إنشاؤه على نظامها الأساسي

أطلقت Meta مولد صور يعمل بالذكاء الاصطناعي في سبتمبر من العام الماضي وستقوم بتحديد جميع الصور التي استخدمت منشئها

“تذهب توصيات مجلس الإدارة إلى أبعد من ذلك حيث نصحت الشركة بتوسيع سياسة الوسائط التي تم التلاعب بها لتشمل الصوت، وتوضح بوضوح الأضرار التي تسعى إلى تقليلها، والبدء في تصنيف هذه الأنواع من المنشورات على نطاق أوسع مما تم الإعلان عنه،” المتحدث باسم مجلس الرقابة وقال دان تشيسون لموقع Dailymail.com.

وتابع: “يسمح وضع العلامات لـ Meta بترك المزيد من المحتوى وحماية حرية التعبير.

ومع ذلك، من المهم أن تحدد الشركة بوضوح المشكلات التي تسعى إلى معالجتها، نظرًا لأنه ليست كل المنشورات المعدلة مرفوضة، في غياب خطر مباشر بحدوث ضرر في العالم الحقيقي.

“قد تشمل هذه الأضرار التحريض على العنف أو تضليل الناس بشأن حقهم في التصويت.”

وقالت ميتا يوم الثلاثاء إنها تعمل مع شركاء الصناعة على المعايير الفنية التي ستسهل التعرف على الصور والفيديو والصوت الناتج عن أدوات الذكاء الاصطناعي.

وما يتبقى أن نرى هو مدى نجاحه في وقت أصبح فيه إنشاء وتوزيع الصور التي ينشئها الذكاء الاصطناعي والتي يمكن أن تسبب ضررا أسهل من أي وقت مضى – من المعلومات المضللة عن الانتخابات إلى الصور العارية المزيفة بدون موافقة المشاهير.

أصبحت الصور التي ينشئها الذكاء الاصطناعي مثيرة للقلق بشكل متزايد.

يتم خداع الآلاف من مستخدمي الإنترنت بمشاركة صور مزيفة، مثل الرئيس الفرنسي إيمانويل ماكرون وهو يقف في احتجاج

يتم خداع الآلاف من مستخدمي الإنترنت من خلال مشاركة صور مزيفة، بدءًا من الرئيس الفرنسي إيمانويل ماكرون وهو يقف احتجاجًا وحتى اعتقال دونالد ترامب من قبل الشرطة في مدينة نيويورك.

وقال نيك كليج، رئيس الشؤون العالمية في ميتا، إنه من المهم طرح هذه التصنيفات الآن، في الوقت الذي تجري فيه الانتخابات في جميع أنحاء العالم والتي يمكن أن تحفز المحتوى المضلل.

وقال كليج: “بينما يصبح الفرق بين المحتوى البشري والمحتوى الاصطناعي غير واضح، يرغب الناس في معرفة أين تقع الحدود”.

“غالبًا ما يصادف الأشخاص محتوى تم إنشاؤه بواسطة الذكاء الاصطناعي لأول مرة، وقد أخبرنا مستخدمونا أنهم يقدرون الشفافية حول هذه التكنولوجيا الجديدة.

“لذا من المهم أن نساعد الأشخاص على معرفة متى تم إنشاء المحتوى الواقعي الذي يشاهدونه باستخدام الذكاء الاصطناعي.”

وأوضح كليج أيضًا أن Meta ستعمل على تصنيف “الصور من Google وOpenAI وMicrosoft وAdobe وMidjourney وShutterstock أثناء تنفيذ خططهم لإضافة البيانات الوصفية إلى الصور التي تم إنشاؤها بواسطة أدواتهم”.

قدمت العديد من الصور المزيفة معلومات مضللة وخطيرة في بعض الأحيان يمكن أن تحرض على العنف إذا تركت دون فحص.

وقال مجلس الرقابة إن سياسة الوسائط التي تم التلاعب بها حاليًا في Meta تفتقر إلى “تبرير مقنع، وغير متماسكة ومربكة للمستخدمين، وتفشل في تحديد الأضرار التي تسعى إلى منعها بوضوح”.

وقال مايكل ماكونيل، الرئيس المشارك لمجلس الإدارة، لبلومبرج: “في الوضع الحالي، هذه السياسة غير منطقية”.

“إنه يحظر مقاطع الفيديو المعدلة التي تظهر الأشخاص وهم يقولون أشياء لا يقولونها، لكنه لا يحظر المنشورات التي تصور شخصًا يفعل شيئًا لم يفعله.” إنه ينطبق فقط على الفيديو الذي تم إنشاؤه من خلال الذكاء الاصطناعي، ولكنه يسمح للمحتوى المزيف الآخر بالإفلات من العقاب.

انتشرت صورة مضللة لاعتقال دونالد ترامب على نطاق واسع، وأثارت غضب الناس الذين اعتقدوا أن الصورة حقيقية

في العام الماضي، ظهرت صورة تظهر الرئيس السابق دونالد ترامب أثناء اعتقاله خارج محكمة في مدينة نيويورك، مما أثار غضب الناس الذين اعتقدوا أن الصورة حقيقية.

قال مجلس الرقابة في Meta إن الخطوة إلى تصنيف الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي تعد بمثابة فوز لمحو الأمية الإعلامية وستمنح المستخدمين السياق الذي يحتاجون إليه لتحديد المحتوى المضلل.

لا يزال مجلس الإدارة يجري مناقشات مع Meta حول توسيع التسميات لتغطية الوسائط والصوت ويدعو الشركة إلى توضيح الأضرار المرتبطة بالوسائط المضللة بوضوح.

لم تستجب Meta لطلب مجلس الرقابة من الشركة بتنفيذ تسميات إضافية لتحديد أي تعديلات تم إجراؤها على المحتوى المنشور.

الفكرة هي أنه من خلال تصنيف المحتوى المضلل، لن تضطر Meta إلى إزالة المنشورات التي يمكن بدورها أن تحمي حق الأشخاص في حرية التعبير وحقهم في التعبير عن أنفسهم.

ومع ذلك، فإن التعديلات مثل المكالمة الآلية التي قلدت صوت الرئيس جو بايدن وطلبت من ناخبي نيو هامبشاير عدم التصويت في الانتخابات التمهيدية، ستظل تبرر قرار مجلس الإدارة بإزالة المحتوى.

ولمكافحة المعلومات المضللة، تبحث شركة ميتا في تطوير التكنولوجيا التي ستكتشف تلقائيًا المحتوى الناتج عن الذكاء الاصطناعي.

وقال كليج: “هذا العمل مهم بشكل خاص لأنه من المرجح أن يصبح مجالاً للخصومة بشكل متزايد في السنوات المقبلة”.

“سيبحث الأشخاص والمنظمات التي ترغب فعليًا في خداع الأشخاص باستخدام محتوى تم إنشاؤه بواسطة الذكاء الاصطناعي عن طرق للالتفاف حول الضمانات الموضوعة لاكتشافه.

“عبر صناعتنا والمجتمع بشكل عام، سنحتاج إلى مواصلة البحث عن طرق للبقاء في المقدمة.”

تواصل موقع Dailymail.com مع Meta للتعليق.

اترك ردك