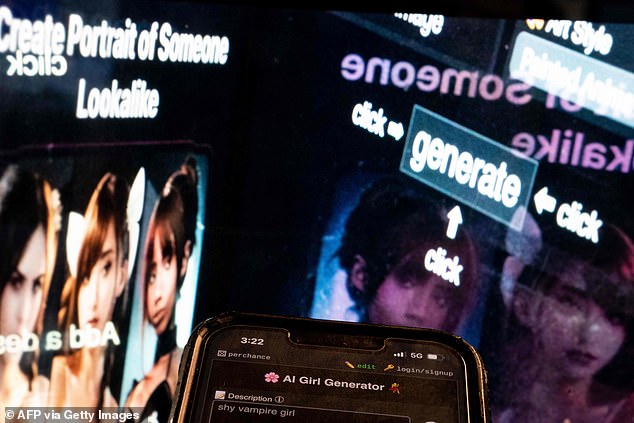

يستخدم عشرات الملايين من الأشخاص تطبيقات “nudify” المدعومة بالذكاء الاصطناعي، وفقًا لتحليل جديد يظهر الجانب المظلم لهذه التكنولوجيا.

زارها أكثر من 24 مليون شخص مواقع الذكاء الاصطناعي العارية في سبتمبر الذي تعديل الصور رقميًا، خاصة النساء، لجعلهن يظهرن عاريات في الصورة باستخدام خوارزميات التعلم العميق.

يتم تدريب هذه الخوارزميات على الصور الموجودة للنساء مما يسمح لها بتركيب صور واقعية لأجزاء الجسم العارية، بغض النظر عما إذا كان الشخص المصور يرتدي ملابس أم لا.

ستعمل إعلانات pam عبر المنصات الرئيسية أيضًا على توجيه الأشخاص إلى المواقع والتطبيقات بنسبة تزيد عن 2000 بالمائة منذ بداية عام 2023.

ينتشر ارتفاع التطبيقات التي تروج للعري بشكل خاص على وسائل التواصل الاجتماعي، بما في ذلك YouTube وReddit وX من Google، كما تم العثور على 52 مجموعة Telegram تستخدم للوصول إلى خدمات الصور الحميمية غير التوافقية (NCII).

تزداد شعبية تطبيقات الذكاء الاصطناعي “العري”، مما يسمح للأشخاص بـ “خلع ملابس” النساء دون موافقتهن

وقال متحدث باسم Telegram لموقع Dailymail.com: “منذ إنشائها، قامت Telegram بالإشراف بشكل نشط على المحتوى الضار على منصتها، بما في ذلك المواد الإباحية غير التوافقية.

“يراقب مشرفو Telegram الأجزاء العامة من النظام الأساسي بشكل نشط ويقبلون تقارير المستخدم من أجل إزالة المحتوى الذي ينتهك شروط الخدمة الخاصة بنا.”

اتصل موقع DailyMail.com بـ X وYouTube للتعليق.

تم استهداف الطالبات من خلال صور مزيفة في مدرسة ثانوية في نيوجيرسي الشهر الماضي بعد أن تم تداول صور عارية تم إنشاؤها بواسطة الذكاء الاصطناعي في جميع أنحاء المدرسة، مما دفع الأم وابنتها البالغة من العمر 14 عامًا إلى الدعوة إلى حماية أفضل من محتوى NCII.

ووقعت حادثة مماثلة في مدرسة ثانوية في سياتل، واشنطن، في وقت سابق من هذا العام، حيث يُزعم أن صبيًا استخدم تطبيقات الذكاء الاصطناعي العميق لإنشاء صور للطالبات.

وفي سبتمبر/أيلول، وقعت أكثر من 20 فتاة ضحايا لصور مزيفة باستخدام تطبيق الذكاء الاصطناعي “Clothoff” الذي يسمح للمستخدمين “بخلع ملابس الفتيات مجانًا”.

تم إجراء التقرير من قبل شركة Graphika – وهي شركة لتحليل الشبكات الاجتماعية – والتي قالت إنها حددت التكتيكات والتقنيات والإجراءات الرئيسية التي يستخدمها مقدمو خدمات NCII الاصطناعية لفهم كيفية عمل مواقع وتطبيقات العري التي أنشأها الذكاء الاصطناعي وتحقيق الدخل من أنشطتهم.

وقال الباحثون في التقرير: “إننا نقيم أن الأهمية المتزايدة لهذه الخدمات وإمكانية الوصول إليها ستؤدي على الأرجح إلى مزيد من حالات الضرر عبر الإنترنت، مثل إنشاء ونشر صور عارية بدون موافقة، وحملات التحرش المستهدفة، والابتزاز الجنسي، وتوليد من مواد الاعتداء الجنسي على الأطفال.

وجدت Graphika أن التطبيقات تعمل على ما يسمى بـ “نموذج freemium” الذي يقدم كمية صغيرة من الخدمات مجانًا مع الحفاظ على الخدمات المحسنة مقفلة خلف نظام حظر الاشتراك غير المدفوع.

للوصول إلى الميزات الإضافية، غالبًا ما يُطلب من المستخدمين شراء “أرصدة” أو “رموز مميزة” إضافية، بأسعار تتراوح من 1.99 دولارًا لكل رصيد إلى 299 دولارًا.

وكشف التقرير أيضًا أن الإعلانات الخاصة بتطبيقات أو مواقع NCII واضحة في أوصافها، حيث تشير إلى أنها تقدم خدمات “خلع الملابس” أو تنشر صورًا لأشخاص “خلعوا ملابسهم” كدليل.

الإعلانات الأخرى لا يتم توجيهها وتختبئ خلف الادعاء بأنها “خدمة فنية تعمل بالذكاء الاصطناعي” أو “معرض صور web3” ولكنها تتضمن مصطلحات أساسية تتماشى مع NCII في ملفاتهم الشخصية ومرفقة بمنشوراتهم.

تم استهداف الفتيات المراهقات في جنوب إسبانيا من قبل أشخاص يستخدمون تطبيق Clothoff

لا تزال مقاطع الفيديو التعليمية على YouTube التي تخبر المشاهدين بالضبط عن كيفية استخدام تطبيقات “nudify” أو الإعلان عن التطبيقات التي يجب استخدامها متداولة على النظام الأساسي ضمن بحث سريع عن “تطبيق العري بالذكاء الاصطناعي”.

وبينما حذرت العديد من مقاطع الفيديو من التطبيقات المتداولة، يتضمن البعض الآخر عنوان “اجعل أي صورة عارية باستخدام هذا الذكاء الاصطناعي” أو “إنشاء صور الذكاء الاصطناعي NSFW (غير آمنة للعمل).”

رفعت لجنة التجارة الفيدرالية (FTC) شكوى إلى مكتب حقوق الطبع والنشر الأمريكي يوم الخميس، بحجة الحاجة إلى مراقبة تأثير الذكاء الاصطناعي التوليدي لحماية المستهلكين.

“الطريقة التي تقوم بها الشركات بتطوير وإصدار أدوات الذكاء الاصطناعي التوليدية ومنتجات الذكاء الاصطناعي الأخرى.” . . وقال التعليق: “يثير مخاوف بشأن الضرر المحتمل للمستهلكين والعمال والشركات الصغيرة”.

وأضافت: “تستكشف لجنة التجارة الفيدرالية المخاطر المرتبطة باستخدام الذكاء الاصطناعي، بما في ذلك انتهاكات خصوصية المستهلكين، وأتمتة التمييز والتحيز، والشحن السريع للممارسات الخادعة، ومخططات المحتالين، وأنواع أخرى من عمليات الاحتيال”.

لا توجد حاليًا قوانين تحظر المواد الإباحية العميقة. في حين أصدر الرئيس جو بايدن أمرًا تنفيذيًا بشأن تنظيم الذكاء الاصطناعي يوفر مبادئ توجيهية لرصد واكتشاف المحتوى الناتج عن الذكاء الاصطناعي، فإنه لا يتضمن قانونًا على مستوى البلاد يحظره تمامًا.

وقالت المعالجة النفسية ليزا سانفيليبو، التي تشمل خبرتها في مجال الصدمات الجنسية، لموقع Business Insider، إن إنشاء صور عُري “يعد انتهاكًا كبيرًا” لخصوصية الأشخاص ويمكن أن يسبب صدمة شديدة للضحية.

وقالت للمنفذ أن “رؤية صورك – أو الصور المزورة لتبدو مثلك، في أفعال قد تجدها مستهجنة أو مخيفة أو قد تكون مخصصة لحياتك الشخصية فقط، يمكن أن تكون مزعزعة للاستقرار للغاية – بل وصادمة”.

“ليس هناك القدرة على إعطاء الموافقة هناك.”

وأضافت: “إنها إساءة عندما يأخذ شخص ما شيئًا من شخص آخر لم يُمنح له بحرية”.

تواصل موقع Dailymail.com مع لجنة التجارة الفيدرالية (FTC) وReddit للتعليق.

اترك ردك